游戏引擎技术到底是怎么被用来拍电影的?

传说中的虚拟影棚究竟是个啥?

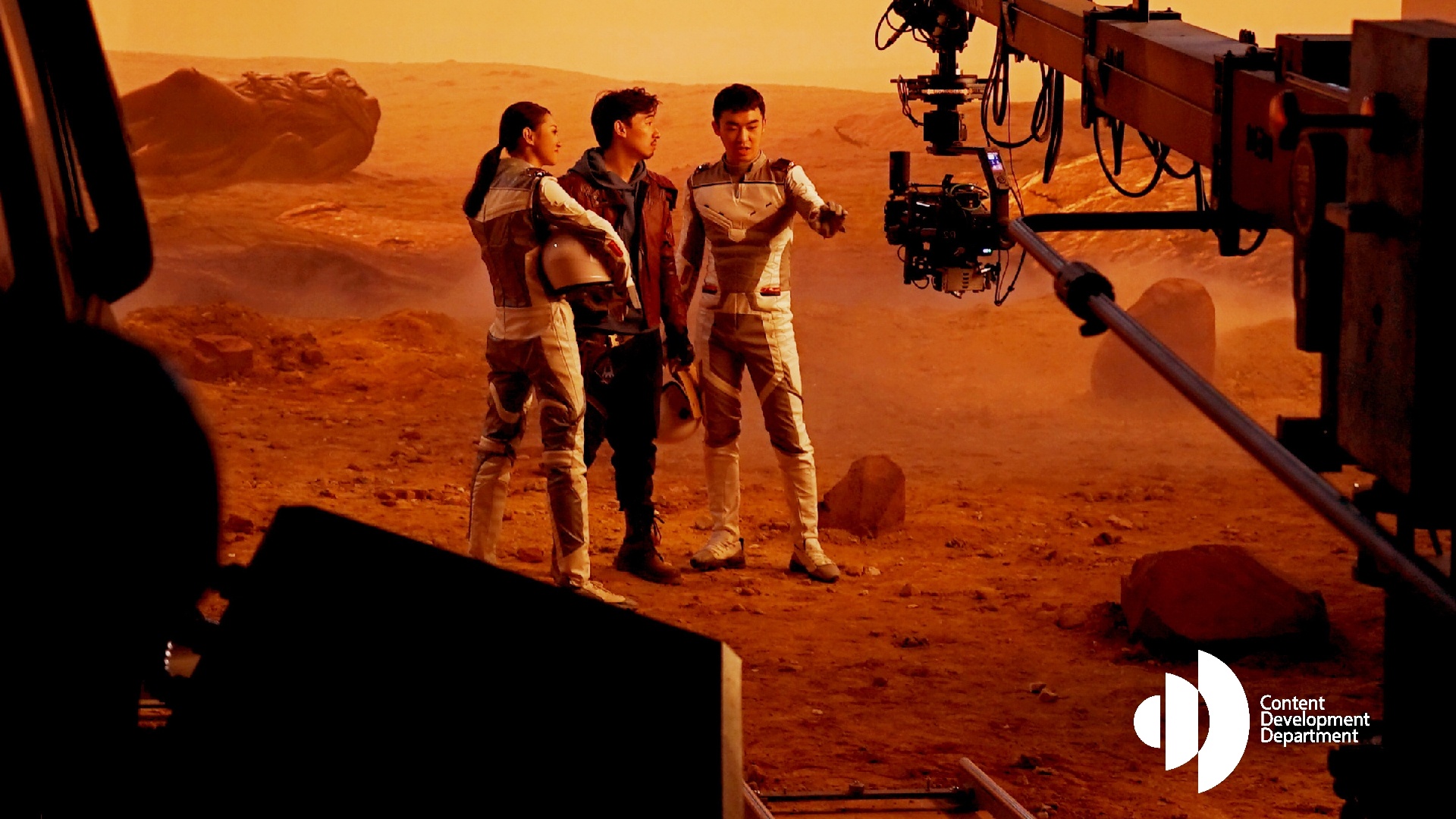

当我走进虚拟影棚时,腾讯互动影游团队正在拍一场隧道里飙车的戏。

那个画面还是相当震撼的,只见一个巨大的 U 型 LED 屏幕,屏幕前的空地上摆着一辆面包车,一台摄像机正对准这辆车以及它背后的 LED 屏幕。当导演喊出「3,2,1,Action」,LED 屏幕立即开始播放隧道前进的画面,男主角跳到车顶上,与画面配合着做出「站不稳」、「趴下躲路牌」等表演……

在一旁的监视器上,我们能实时看到摄像机拍下的画面:LED 屏幕的隧道背景、面包车和男主角,完全融合在了一起,几乎看不出什么破绽,就像是真的在隧道里拍的一样。

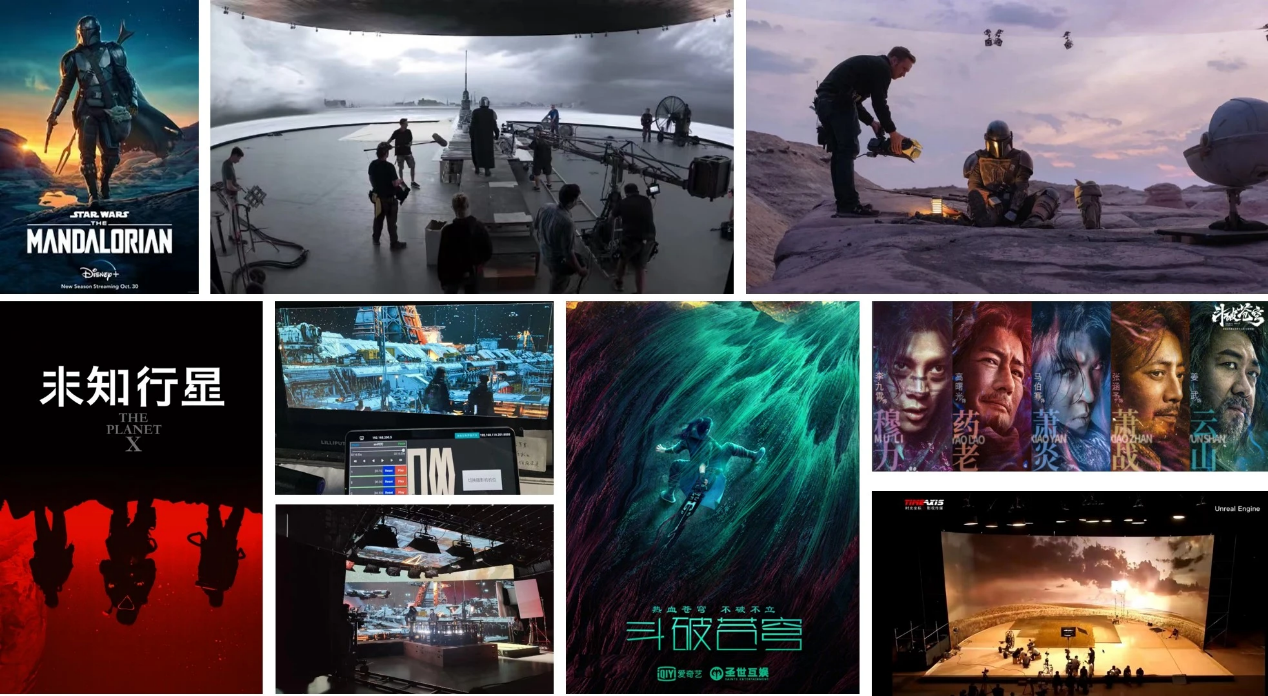

虚拟影棚,用游戏引擎技术实时渲染输出超高品质的特效场景来帮助影视作品拍摄一种技术,过去的两年多时间里,这项技术发展势头十分迅猛,备受青睐,在《曼达洛人》、《新蝙蝠侠》、《星际迷航:奇异新世界》等作品中均有用到,也已经算是一项比较普遍,不那么稀奇的技术了。

然而,亲眼所见时,还是觉得挺震撼的。在腾讯互娱 CDD 虚拟影棚的现场,技术团队向我们介绍了一下这套技术方案的详细情况。

虚拟影棚是怎么工作的?

这个虚拟影棚里,最主要的是一块 U 型的立屏,尺寸是 40m × 6m,分辨率是 17280 × 2592,7000 万像素,60 FPS 帧率,100% DCI-P3 电影行业标准色域。上方还悬吊着一块可升降的天幕屏,尺寸为 125㎡。

这些参数,普通人一看可能没什么概念,举一些我们更熟悉的例子做对比吧:市面上的电视或者显示器经常会以「4K 分辨率」作为卖点,象征画质高清,但虚拟影棚 LED 屏幕的分辨率相当于 17K,差距一目了然。

总结来说,虚拟影棚的 LED 屏幕对画质的呈现能力是顶级的。

有了屏幕,就需要有东西能放在上面 —— 在影视行业,被用来放在 LED 屏幕上做特效场景、或者叫背景的内容,都被称为「资产」,据技术团队介绍,因为这些场景都是存放在一个资产库里、可以被重复利用的。

而这些资产,就是由游戏引擎技术来打造的。

其实影视行业「虚拟画面当背景」这件事并不新奇,早在拍摄《奥特曼》的年代,人们就已经会用图片或投影来做背景了。然而,那种背景要么是静态的,要么即使是动态、也是平面且固定视角的,很不灵活,拍出来多少会显得「你这背景太假了」,因此后来基本上都被「绿幕拍摄 + 后期特效」的技术替代了。

然而,如今的虚拟影棚却是一项更为先进的技术,虽然思路上也是「虚拟画面当背景」,但这个背景效果能做得非常逼真,一点儿也不假。

首先,虚拟影棚的资产并不是 2D 平面的,其实一个 3D 立体的场景模型,就像游戏里的场景一样。

在这个 3D 的场景里,我们可以根据拍摄需求做很多设置,比如光从哪边照过来、是白天还是黑夜、是雨天还是晴天、色调是暗黑还是明艳……

此外,虚拟影棚的摄像机上会安装一个定位追踪器,当现场摄影机运动时,通过定位系统驱动游戏引擎内的虚拟摄影机运动,使得 LED 屏幕内背景环境中的 3D 资产进行实时渲染,最终得到具有真实自然透视变化的拍摄画面 —— 这项技术被称为「视锥跟踪」技术,也是虚拟制片中最为先进的环节之一。

因此,尽管听上去就是一个「虚拟画面当背景」的事,但由于效果足够逼真,因此这样拍下来的画面就已经是接近「绿幕拍摄 + 后期特效」的水准,相当于把原本拆分为两个阶段的「绿幕拍摄」和「后期特效」两件事合并在了一起。

这种拍摄技术不仅提升了效率,缩短了整体的影视制作周期,还大大降低了拍摄的资金成本。以那个隧道里飙车的戏为例,如果要实地拍摄,需要跟有关部门报备、走审批流程、封锁道路……无论是时间还是资金成本都十分可观,更不用提如果发现没拍好、需要重拍或者补镜头有多麻烦。而如果是在虚拟影棚里,一切就省事多了。

「一般来说那种普通城市街景,或者比较常见的自然风光类的,可能实地拍摄会比较适合,但如果是那种虚构科幻场景,或者是脱离日常的场面,比如雪山、战场、荒漠、太空戈壁之类的,虚拟影棚就很有优势了。」腾讯互娱虚拟影棚现场,一位剧组导演这样说。

而对演员来说,这也显然是一项更友好的技术,他们不再需要对着绿幕脑补周围环境,LED 屏幕就直接能展示出来,而且沉浸感非常强。在腾讯互娱虚拟影棚现场参观时,他们正在拍一段趴在车顶躲避路牌的戏:大屏幕上路牌一出现,演员就趴下,我甚至觉得他仿佛在玩一个体感游戏。

而上面所说的这一切之所以能够实现,都是得益于游戏引擎技术能力的进步。

游戏引擎的「实时渲染」

在游戏行业,有句话叫:判别一个游戏的画质怎么样,看 CG 动画没用,得看实机演示。其实就是因为 CG 动画都是「离线渲染」做出来的,而实机演示才是「实时渲染」,是最终玩家游戏时会看到的画面。

「渲染」是计算机把设置好的画面信息运算出来、并投放到显示屏幕上的过程。理论上,输出画面的品质越高,运算量就越大,渲染时间就更久。

离线渲染是预先设置好建模、光影、贴图等参数,设置的过程中是看不到最终画面效果的,设置完毕后,再让计算机来渲染输出最终版画面。这一做法通常被用于影视制作,也包括 CG 动画,因为不必考虑渲染需要多长时间,为了达到更精美的品质,每一帧甚至都可以花数小时来渲染。

而实时渲染则是「边设置、边输出画面」方式,游戏用的就是这种,因为玩家会不停地输入各种操作,操作的结果需要实时地反馈在画面上:比如推一下遥感,角色就立刻向前移动。所以渲染每时每刻都在进行,对计算机的运算能力要求更高。然而考虑到一般家用电脑和游戏主机的配置上限,为了确保画面流畅不卡顿,就必然会牺牲一些画质。

然而,随着计算机和游戏引擎技术的提升,实时渲染在「画质」这方面的劣势已经逐渐被消弭 —— 如今实时渲染所输出的画面,已经可以达到「影视级」标准,而这一项进步,就是虚拟影棚技术得以成立的关键。

以腾讯互娱虚拟影棚为例,与 Epic 公司顶尖的虚幻引擎(Unreal Engine)合作,其资产可以通过 Unreal 商城购买并组合完成,也可以定制化创作,这些内容都可以被纳入资产库,在同类作品的拍摄中被拿出来调整、重新组合、反复使用。视大小和复杂程度不同,文件体量通常在几个 G 甚至十几个 G 以上。

和游戏一样,为了确保实时渲染过程流畅,没有掉帧或卡顿问题,资产都需要进行反复的优化和打磨。而运行这些资产的硬件,除了对 LED 屏幕的精度、色彩准确度要求极高之外,对计算机的 GPU 要求也很高,腾讯互娱虚拟影棚有十台计算机,每台都配备了双 A6000 的显卡。

得益于「实时渲染」的优势,资产内的很多内容都能实时调整,比如物体的位置、物体的大小、光影效果等,即使是拍摄当天导演对场景突然有了新的想法,也能很快就实现。

「虚拟影棚技术最大的好处就是节省时间,场景想怎么改就能马上改,拍完的效果基本上就是成片了,后期时间就都省掉了。」剧组的导演对我们说,「而对影视行业而言,省时间就是在省钱,成本能降下来,这很重要。」

在国内还在起步阶段

虚拟影棚技术在海外已经相对比较普遍,国内这边在最近一两年跟进得也很快,已经有多个虚拟影棚先后在北京、上海、青岛等多地落成,也越来越普遍地被影视团队所使用。然而,目前国内这项技术依然还是处在起步阶段。

从硬件技术来说,比如 LED 屏幕的显示效果、计算机的算力等,国内的虚拟影棚已经完全不输给国外了,甚至部分国外影棚的大屏幕也是「Made in China」的。

但从内容方面、也就是资产的制作方面,国内的水平距离世界一流仍然有差距。这一点跟游戏的发展也有关,如今,顶尖的游戏引擎都是国外公司研发,顶级画质的 3A 游戏也都是海外大厂走在前面,他们已经积累了丰富的经验和技术实力,但国内游戏公司在 3A 领域的探索才刚起步。

如今,游戏引擎技术的能力已经破圈渗透到了很多其他领域,不仅仅是影视,也包括交通、工业等,游戏引擎技术的突破,也常常会直接改变或颠覆某个其他行业。

因此,有一种观点甚至认为,游戏引擎将成为下一代国际科技竞争中最重要的底层软件之一,也就是说,游戏引擎技术运用得怎么样,将成为评判科技实力高低的标准之一。

尽管目前我们还在起步和追赶的阶段,但近些年国内发布了一系列画质惊艳的 3A 品质新作,我们能看到进步的速度是很快的。

「我们肯定对未来是有信心的,未来无论是影视还是游戏,我们都能做出不输给国际一流品质的优秀作品。」影游项目的剧组里有不少成员也是资深游戏玩家,在现场,他们不约而同地表达了同样的观点。

「IGN 中国」由腾讯集团运营,但「IGN 中国」的编辑团队为独立运作,涉及任何腾讯集团公司、产品或服务的观点、意见、评测与其他重要的论点,均不受腾讯集团影响。